《第一财经》报导,ChatGPT诞生已9个多月,大模型在中国产学界最新进展如何?谈到大模型为何难以首先诞生在高等院校,24日举行的2023世界人工智能大会(WAIC)青年优秀论文奖颁奖仪式暨青年科学家论坛上,同济大学电脑系教授兼副主任何良华认为,学界很难出现ChatGPT这样的模型,主要是算力和数据的问题。

大模型是指具有大量参数和计算资源的机器学习模型。这些模型通常在训练过程中需要大量的数据和计算能力,并且具有数百万到数十亿个参数。

何良华说,大模型非常吃算力,大学也难以去购买大量的算力。而有了算力之后,要把参数训练得比较成熟,需要海量的数据,但是学界是拿不到这么多数据的。除了这两个问题,还和学界自身的需求有关。「我们都期望在理论上做一些创新。比如我的学生如果跟我说现在需要几千张卡(算力)来做一个事情,我所有的经费给他也不够,课题也难以立项。因为它既不是应用,又不是理论,找不到这样一笔经费,研究只能中断。」

和团队率先在中国发布了具备ChatGPT能力语言模型MOSS的复旦大学电脑学院教授邱锡鹏表示,大模型更顶尖的研究机构在业界,这是一个不可回避的事实。从DeepMind再到OpenAI,都是如此。美国的很多著名大学,从研究实力上看,已经落后于这些顶级的研究院了。

邱锡鹏解释,学校和研究院的差异还是在于自由的探索。对于很多研究院来讲,长期的目标还是奔着营利,包括中国很多企业之前也建了很多研究院,过不了几年就发现可能面临着营利、变现的压力,导致做的研究不是特别纯粹。在他看来,OpenAI的团队是一个以前没有出现过的形态,这种制度设计非常好,能使团队既能坚持本心做研究,同时也没有那么大的压力。

「在学校的话还是要发挥学校的长处,做的研究没有太多的营利要求或面临短期变现的压力,也可以思考得更长远。特别在如今高算力要求的情况下,在学术界和产业界的研究院之间,还是可以发挥学术界的优势。」他说。

上海科技大学生物医学工程学院常任助理教授钱学骏则认为,中国工业界做出的很多有影响力的工作,可能不是学界追求的主要目标。「学界可能更想(发明)一种思路上的创新(新想法、新应用),而不是通过大算力、大数据,各方面的优势集中做出来了,对学界来说这些也不够有优势,无法获得大量数据。」

华为诺亚方舟实验室AI研究员谢恩泽说,怎么构建高品质的数据集,可能是对于大模型能力一个很重要的补充。训练大模型本身来说,用多大参数的模型、配多大的数据量,以及用多长时间,这些协同也是很重要的。而这些只有在少数几个大厂才有机会接触到这些资源。

今年以来,生成式人工智能的发展成为地方政府和科技大厂瞄准的关键字。中国科技部人工智能发展研究中心5月底发布的《中国人工智能大模型地图研究报告》显示,当前中国10亿参数规模以上的大模型已发布79个。

《第一财经》报导,不久前浦江基础科学发展论坛上,北京清华大学人工智能研究院常务副院长孙茂松教授表示,中国乃至全球发展大模型最终的突破关键,是基础科学的突破。

他说,对于大模型,当前的问题在于并不清楚OpenAI的机理是如何运作的,就连推出ChatGPT的OpenAI公司执行长萨姆·奥特曼也表示,虽然做出了GPT但也不清楚发生的原理,「实际上就是对这个机理还不清楚」。他认为,现有的人工智能模型已经能做到说话通顺,但这个问题的内在实现逻辑仍然十分复杂。如果弄清楚了大模型里的规律、ChatGPT背后的机理,就有可能克服现有人工智能大模型的局限性,建立下一代人工智能的理论和模型。

他说,对于大模型,当前的问题在于并不清楚OpenAI的机理是如何运作的,就连推出ChatGPT的OpenAI公司执行长萨姆·奥特曼也表示,虽然做出了GPT但也不清楚发生的原理,「实际上就是对这个机理还不清楚」。他认为,现有的人工智能模型已经能做到说话通顺,但这个问题的内在实现逻辑仍然十分复杂。如果弄清楚了大模型里的规律、ChatGPT背后的机理,就有可能克服现有人工智能大模型的局限性,建立下一代人工智能的理论和模型。

Iteca Exhibitions

Iteca Exhibitions 长城润滑油

长城润滑油 German Machine Tool Builders Association

German Machine Tool Builders Association 延长石油

延长石油 3M制造业

3M制造业 陕煤化工集团

陕煤化工集团 HUAWEI

HUAWEI Dahua Technology

Dahua Technology 中国石油

中国石油 Gemtique

Gemtique KUNVII

KUNVII PALEXPO

PALEXPO IAA Show

IAA Show LASTON

LASTON 中杭贸易

中杭贸易 Etek Europe

Etek Europe PV EXPO

PV EXPO QIIE青岛进博会

QIIE青岛进博会 陕西有色金属

陕西有色金属 维远光伏产业

维远光伏产业 Time Out Group

Time Out Group IFEMA

IFEMA 天元化工

天元化工 National Media

National Media 吉祥星科技

吉祥星科技 Dowpol Chemical

Dowpol Chemical 海康威视-HIK VISION

海康威视-HIK VISION Hannover Messe

Hannover Messe TOSHIBA

TOSHIBA Productronica

Productronica HealthCare

HealthCare 深圳会展中心

深圳会展中心 大唐旗舰店

大唐旗舰店 Soul Game

Soul Game 神木职教中心

神木职教中心 Sinopec

Sinopec 崔培鲁画家在北京工作室

崔培鲁画家在北京工作室 40周年庆典今天揭幕 16分钟燃情大片献礼深圳

40周年庆典今天揭幕 16分钟燃情大片献礼深圳 二十国集团贸易部长会强调推动国际贸易

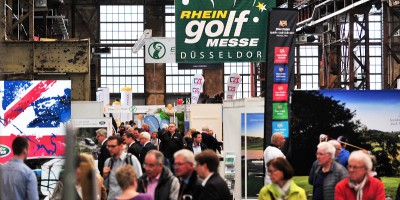

二十国集团贸易部长会强调推动国际贸易 杜塞尔多夫国际高尔夫用品展览会

杜塞尔多夫国际高尔夫用品展览会 深圳与广州城市建设实力对比

深圳与广州城市建设实力对比 崔培鲁《艺术传承书画同源》画展采访

崔培鲁《艺术传承书画同源》画展采访 1980年中国创立了深圳、珠海、汕头、厦门经济特区

1980年中国创立了深圳、珠海、汕头、厦门经济特区 非物质文化遗产展示——福聚号陶艺

非物质文化遗产展示——福聚号陶艺 美国多个城市点票站爆发抗议

美国多个城市点票站爆发抗议 西藏拉林高等级公路上的“最美大桥”

西藏拉林高等级公路上的“最美大桥” 欧洲展会玻璃水晶特装设计与效果展示

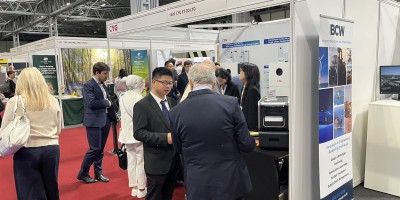

欧洲展会玻璃水晶特装设计与效果展示 Battery Cells & Systems Expo 2024

Battery Cells & Systems Expo 2024 杜塞尔多夫国际高尔夫用品展览会

杜塞尔多夫国际高尔夫用品展览会 深美闳约:宝能第一空间联展_西乐群山水作品

深美闳约:宝能第一空间联展_西乐群山水作品 Khimia 2022 Photo

Khimia 2022 Photo 北京2022年冬残奥会闭幕式在国家体育馆举行

北京2022年冬残奥会闭幕式在国家体育馆举行 2023年韩国消费电子及电子元器件展 KES

2023年韩国消费电子及电子元器件展 KES WALL-HUNG TOILET ZT-1021

WALL-HUNG TOILET ZT-1021 2024第十一届广州国际汽车零部件及加工技术/汽车模具展会

2024第十一届广州国际汽车零部件及加工技术/汽车模具展会 长征者-开国少将曾美油画

长征者-开国少将曾美油画 2023年印度国际包装工业展览会

2023年印度国际包装工业展览会 专业提供环保全玻璃展位特装

专业提供环保全玻璃展位特装 北京物联网展普通标展国内预订

北京物联网展普通标展国内预订 LEMASS 4K AI 智能电视

LEMASS 4K AI 智能电视 意大利里米尼城市介绍

意大利里米尼城市介绍 纽伦堡 - 玩具都城

纽伦堡 - 玩具都城 慕尼黑 - 伊萨尔河畔的酒都

慕尼黑 - 伊萨尔河畔的酒都 法兰克福 - 欧洲金融中心

法兰克福 - 欧洲金融中心 迪拜 - Dubal

迪拜 - Dubal 俄罗斯 - 战斗民族和套娃的国家

俄罗斯 - 战斗民族和套娃的国家 葡萄牙 - 软木塞之乡

葡萄牙 - 软木塞之乡 西班牙 - 斗牛士的故乡

西班牙 - 斗牛士的故乡